yuns

GNN소개 및 내용 정리 본문

반응형

GNN 소개 — 기초부터 논문까지

이 글은 Shanon Hong의 An Introduction to Graph Neural Network(GNN) For Analysing Structured Data를 저자에게 허락받고 번역, 각색한 글이다.

medium.com

An Introduction to Graph Neural Network(GNN) For Analysing Structured Data

Understand What GNN Is and What GNN Can Do

towardsdatascience.com

- Graph Theory

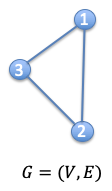

- graph = vertices + edges

- G = (V, E) where V is a set of nodes and E is the edges between the nodes

- Adjacency Matrix: A로 표현하며 차원은 $N\times N$.

- Feature Matrix: 각 노드의 feature를 나타내며 차원은 $N\times F$

Why is a graph difficult to analyze?

- 그래프가 Eucliean space상에 존재하지 않기 때문에

- 그래프가 고정되어 있는 형태가 아니기 때문에

- 인간이 해석하기 쉽도록 visualization이 어렵기 때문에

Why use Graphs?

- relationship과 interaction와 같은 개념에 대하여 제공을 잘해준다.

- 풀고자 하는 문제상황을 단순화시켜 접근할 수 있다.

Traditional Graph Analysis Methods

- searching algorithm

- BFS

- DFS

- Shortest path algorithm

- Dijkstra's algorithm

- Nearest Neighbor

- spanning-tree algorithm

- Prim's algorithm

- Clustering methods

- Highly Connected Components

- k-mean algorithm

한계: 알고리즘을 적용하기 전에 입력 그래프에 대한 prior knowledge 필요

Graph Neural Network

- node가 이웃과의 연결에 의해 정의된다

- 연결이 되어 있지 않은 점은 의미가 없음

- node embedding: final state of the node

Recurrent Graph Neural Network

- Banach Fixed-Point Theorem

반응형

'graph deep learning > #4 Vanilla Graph Neural Networks' 카테고리의 다른 글

| 4.3 Limitations (0) | 2020.11.07 |

|---|---|

| 4.2 Model (0) | 2020.11.07 |

| 4.1 Introduction (0) | 2020.11.06 |

Comments